保险运维日志管理与日志分析项目是保障保险公司信息系统稳定运行、提升运维效率与风险管理能力的重要举措。以下是完整的系统方案设计思路及具体设计内容,重点介绍数据处理服务部分。

一、系统总体设计

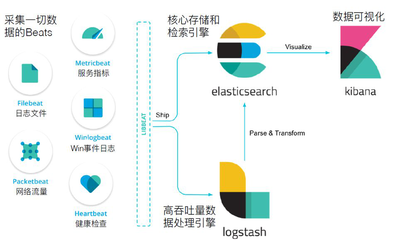

保险运维日志管理系统通常采用分层架构:数据采集层、数据处理层、数据存储层和应用分析层。整体方案需满足高可用性、可扩展性和安全性要求,支持实时与批量处理,并符合保险行业监管规定。

二、具体设计内容

- 数据采集设计

- 日志源识别:涵盖应用系统、网络设备、数据库、安全设备及云平台日志

- 采集方式:支持Agent、API接口、Syslog等多种方式

- 日志标准化:定义统一的日志格式规范

- 数据处理服务设计(核心部分)

- 数据解析:通过正则表达式、GroK模式等技术解析非结构化日志

- 数据清洗:过滤无效数据、去重、补全缺失字段

- 数据分类:按业务类型(承保、理赔、财务等)和级别(ERROR、WARN、INFO)分类

- 数据增强:关联业务上下文,添加地理信息、用户标签等元数据

- 实时处理:使用流处理技术(如Flink、Spark Streaming)实现异常实时告警

- 批量处理:通过ETL工具定期处理历史数据,支持离线分析

- 数据存储设计

- 热数据存储:采用Elasticsearch等搜索引擎,支持快速查询

- 冷数据存储:使用HDFS或数据仓库进行长期归档

- 数据索引:建立多维度索引(时间、业务类型、严重程度等)

- 分析应用设计

- 可视化展示:通过仪表盘展示系统健康度、业务趋势等

- 智能分析:应用机器学习算法进行异常检测、根因分析

- 告警管理:配置阈值告警、智能预测告警

- 安全与合规设计

- 访问控制:基于角色的权限管理

- 审计追踪:记录所有日志访问操作

- 数据加密:传输和存储过程中的数据加密

三、数据处理服务关键技术选型

建议采用分布式处理框架(如Spark、Flink),结合消息队列(Kafka)实现数据缓冲,使用日志解析库(如Logstash)进行格式转换,并通过规则引擎实现智能分类。

本方案通过完善的数据处理服务设计,能够帮助保险公司实现运维日志的全生命周期管理,提升系统稳定性,支持业务决策,并满足监管合规要求。